ライブ配信サービス「SHOWROOM」を運営するSHOWROOM株式会社が、悪質コメントを検知し、投稿前にブロックする機能「コンテンツモデレーションAI」を開発、「SHOWROOM」に搭載した。

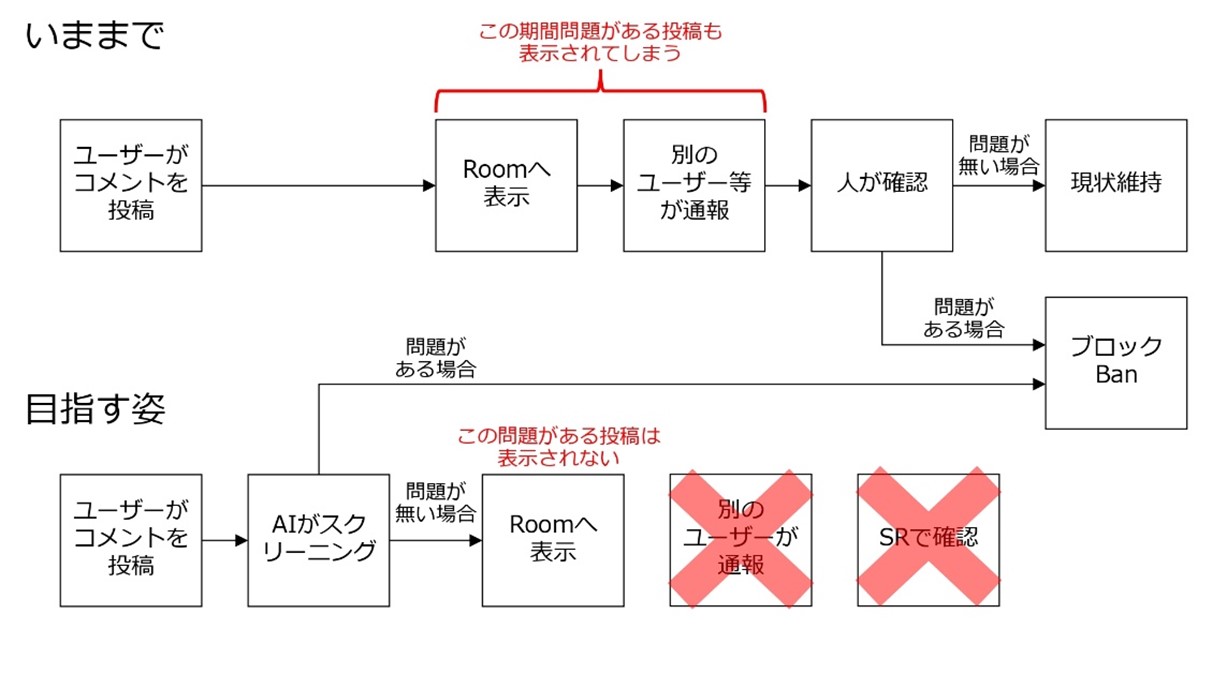

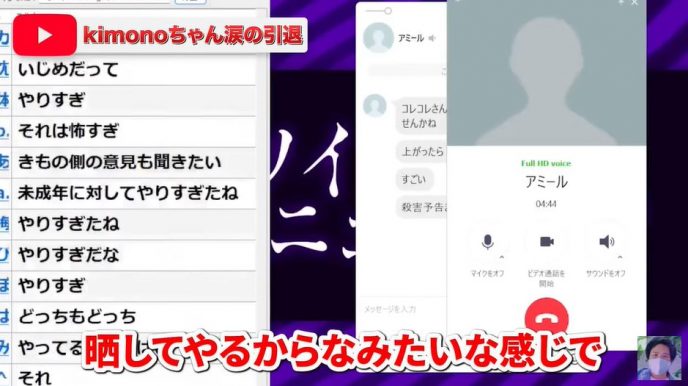

これまで「SHOWROOM」では、視聴者からの悪質なコメントを別の視聴者やライバー(ライブ配信者)自身が通報、通報を受けたSHOWROOM監視チームがコメント確認し、ブロック作業を行っていた。そのため、監視チームが該当コメントの確認を完了するまでは、そのコメントが表示されていた。

今回新たにSHOWROOMが独自に開発したコンテンツモデレーションAIは、視聴者によって誹謗中傷を中心とする悪質なコメントが書き込まれた際、AIがスクリーニングを実施。コメントに問題がある場合は、投稿される前に自動でブロックするものだ。

従来の手法では、複数回に分け書き込まれたコメントや、日本語特有の遠回しな言い方など、検出が難しかった悪質なコメントもあった。しかし、SHOWROOMのAI分析チームは、コンテンツモデレーションAIの搭載によって不快なコメントを目にする機会が軽減、また連鎖を防げるようになると考えているという。

今回、まずはAIがユーザーの変わりに通報を行うファーストステージを導入。最終的には、「SHOWROOM」内で、誹謗中傷を中心とした悪質コメントの100%排除に限りなく近くなることを目指すとしている。

SNSなどのプラットフォームに書き込まれた誹謗中傷コメントが社会問題になるなか、今回のSHOWROOMの取り組によって、よりライバーも視聴者も気持ちよくサービスが利用できるようになることを期待したい。

出典:SHOWROOM、日本初となるコンテンツモデレーションAI機能(特許出願中)を自社にて開発 仮想ライブ空間「SHOWROOM」に搭載へ | PRTIMES

コメントする